Corea del Sur crea un código ético para la convivencia entre robots y humanos

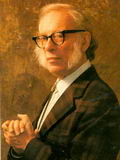

Corea del Sur adoptará este año el primer código ético para robots del mundo, inspirado en una novela de ciencia ficción de Isaac Asimov, con el fin de evitar posibles abusos de los humanos.

Corea del Sur adoptará este año el primer código ético para robots del mundo, inspirado en una novela de ciencia ficción de Isaac Asimov, con el fin de evitar posibles abusos de los humanos.

El Ministerio surcoreano de Comercio, Industria y Energía espera adoptar antes de final de año la 'carta ética de los robots', sobre la que trabaja un comité de expertos desde el pasado mes de noviembre, según fuentes ministeriales. Además, el Gobierno desea incluir esta declaración de principios en los textos de los escolares del país.

El jefe del departamento de robots del Ministerio, Shim Hak-bong, explicó que la carta ética se elabora con vistas a la llegada de los robots pensantes en un futuro próximo, por lo que considera necesario establecer una línea de conducta ética. Corea del Sur, uno de los países de Asia más avanzados tecnológicamente, quiere convertirse en un referente mundial en robótica y con este código de conducta pretende sentar las bases del papel y la función que tendrán los robots en el futuro, así como incentivar su demanda.

Además del texto de Asimov, los expertos tienen en cuenta las experiencias en robótica de otros países y recogen opiniones de internet. En el plano internacional, el Instituto de Ingenieros Eléctricos y Electrónicos (IEEE) formó en 2004 un comité tecnológico para preparar una ética de robots, mientras que la Red de Investigación Europea sobre Robótica (EURON) tiene previsto difundir en abril una hoja de ruta sobre esta materia, según el Ministerio surcoreano.

Encuentre más de la misma fuente en kotinussa.wordpress.com. Artículo amparado con Licencia CC Reconocimiento 3.0.

Nota del editor

En ciencia ficción las tres leyes de la robótica son un conjunto de normas escritas por Isaac Asimov, que la mayoría de los robots de sus novelas y cuentos están diseñados para cumplir. En ese universo, las leyes son "formulaciones matemáticas impresas en los senderos positrónicos del cerebro" de los robots (lo que hoy llamaríamos ROM). Aparecidas por primera vez en el libro "Runaround" (1942), establecen lo siguiente:

En ciencia ficción las tres leyes de la robótica son un conjunto de normas escritas por Isaac Asimov, que la mayoría de los robots de sus novelas y cuentos están diseñados para cumplir. En ese universo, las leyes son "formulaciones matemáticas impresas en los senderos positrónicos del cerebro" de los robots (lo que hoy llamaríamos ROM). Aparecidas por primera vez en el libro "Runaround" (1942), establecen lo siguiente:

1. Un robot no debe dañar a un ser humano o, por su inacción, dejar que un ser humano sufra daño.

2. Un robot debe obedecer las órdenes que le son dadas por un ser humano, excepto si estas órdenes entran en conflicto con la Primera Ley.

3. Un robot debe proteger su propia existencia, hasta donde esta protección no entre en conflicto con la Primera o la Segunda Ley.

Esta redacción de las leyes es la forma convencional en la que los humanos de las historias las enuncian; su forma real sería la de una serie de instrucciones equivalentes y mucho más complejas en el cerebro del robot.

Estas leyes surgen como medida de protección para los seres humanos. Según el propio Asimov, la concepción de las leyes de la robótica quería contrarrestar un supuesto "complejo de Frankenstein", es decir, un temor que el ser humano desarrollaría frente a unas máquinas que hipotéticamente pudieran rebelarse y alzarse contra sus creadores. De intentar siquiera desobedecer una de las leyes, el cerebro positrónico del robot resultaría dañado irreversiblemente y el robot moriría. A un primer nivel no presenta ningún problema dotar a los robots con tales leyes, a fin de cuentas, son máquinas creadas por el hombre para su servicio.

Las tres leyes de la robótica representan el código moral del robot. Un robot va a actuar siempre bajo los imperativos de sus tres leyes. Para todos los efectos, un robot se comportará como un ser moralmente correcto. Sin embargo, es posible preguntar: ¿Es posible que un robot viole alguna de sus tres leyes? ¿Es posible que un robot "dañe" a un ser humano? La mayor parte de las historias de robots de Asimov se basan en situaciones en las que a pesar de las tres leyes, podríamos responder a las anteriores preguntas con un "sí".

Asimov crea un universo en el que los robots son parte fundamental a lo largo de diez mil años de historia humana, y siguen teniendo un papel determinante por diez mil años más. Es lógico pensar que el nivel de desarrollo de los robots variaría con el tiempo, incrementándose su nivel de complejidad cada vez más.

En la ciencia-ficción (vistos, por ejemplo, en Yo, Robot), los primeros robots madriados en la Tierra eran modelos poco avanzados. Era una época en donde la robopsicología no estaba aún desarrollada (¿Nuestro presente?). Estos robots podían ser enfrentados a situaciones en las cuales se vieran en un conflicto con sus leyes. Una de las situaciones más sencillas se da cuando un robot debe dañar a un ser humano para evitar que dos o más sufran daño. Aquí los robots decidían en función de un criterio exclusivamente cuantitativo, quedando luego inutilizados, al verse forzados a violar la primera ley.

Posteriores desarrollos en la robótica, permitieron la construcción de circuitos más complejos, con una mayor capacidad de autorreflexión. Una peculiaridad de los robots es que pueden llegar a redefinir su concepto de "daño" según sus experiencias, y determinar niveles de éste. Su valoración de los seres humanos también puede ser determinada por el ambiente. Es así que un robot puede llegar a dañar a un ser humano por proteger a otro que considere de más valía (su amo, por ejemplo). También podría darse el caso de que un robot dañara físicamente a un ser humano para evitar que otro sea dañado psicológicamente, pues llega a ser una tendencia el considerar los daños psicológicos más graves que los físicos. Estas situaciones nunca se hubieran dado en robots más antiguos. Asimov plantea en sus historias de robots las más diversas situaciones, siempre considerando las posibilidades lógicas que podrían llevar a los robots a tales situaciones.

Fuente: wikipedia.org

Fuente: kotinussa.wordpress.com